結局どのモデルがうちにとって使えるの?

ChatGPTなどのLLM(大規模言語モデル)のニュースを少しでも追いかけている方は、他にも様々なモデルがあることはご存じかと思います。GoogleやMeta(Facebook)はもちろん、Googleが出資し元OpenAIの社員が経営するAnthropicなど様々な会社が独自のAIを開発・提供しています。

WEBやクラウドがそうであったようにAIも企業活動の根幹を支えていくのであればどのモデルを使うべきかはじっくり検討したいところですね。今回の記事では下記の有名なモデルを精度、コスト、使い勝手や連携のしやすさも含めて比較して解説していきたいと思います。

(今回の比較は主にAPIを利用して自社用にカスタマイズすることを念頭に置いています)

比較するモデル

- OpenAI: GPT-4 / GPT 3.5

- Microsoft: Azure OpenAI GPT4/GPT3.5

- Anthropic: Claude2

- Google: Bard / PaLM2

- Meta: Llama2

先に結論:迷ったらOpenAI。しっかりやるならAzure。本気で投資するならLlama2も視野に。

先に全体的な結論ですが、色々モデルはあるものの、やはり答えの精度や使い勝手という意味ではOpenAIがとびぬけています。セキュリティ面などの安定性を求めるのであれば同じモデルをMicrosoftのAzure経由で使うのが良いでしょう。既にAzureを使っていたり、TeamsやMicrosoft系のサービスを使っている方は特におすすめです。

MetaのLlama2が他と全く違う点は商用利用可能なオープンソースモデルだということです。GPTは4からファインチューニングが出来なくなったので、現状自社用にファインチューニングしていって独自のAIを開発するということであればおすすめできる選択肢です。

AnthropicのClaudeとGoogleのPaLM2は今後も要注目です。Claudeが圧倒的に違うのはインプットとして処理できるトークン(文字)量です。GPT4が2000文字程度であるのに対し、Claudeは5万文字程度。書籍をまるごとプロンプトに入れられるのは魅力です。(ただしトークンが多いほどコストも高くなるので、結局はコストに対して最適化する必要はあります)

GoogleのPaLM2は、UIとして提供されているBardにて各陣営の中で先んじてマルチモーダル(テキスト以外もインプットとして扱う)を提供しています。料理の写真から具材をリストアップする、といったものからWEBサイトのラフスケッチを描いて、そのサイトのコードを書かせるなど様々な試みがあります。また、GoogleCloud、ワークスペースなどのサービスを既に使っている方はGoogleの中で完結させたいと思われるかもしれませんね。もしモデルの精度が変わらない場合は各サービスとの連携のしやすさというのはアドバンテージになると思います。

と一通り解説しましたが、各モデルについてもう少し詳しく下記に解説したいと思います。

高機能で高精度 OpenAI GPT4/3.5

強み:答えの精度・機能性 弱み:コスト

解説は不要かもしれませんが、現在の生成AIブームの火付け役でありトップランナーであるOpenAIのGPTは答えの精度は高いです。また現在では様々なプラグインや直接コードを実行できるコードインタープリタという機能も実装しています。

ChatGPT上で使う際はあまり気にならないかもしれませんが、APIではトークンあたりの金額が決まっています。その性能の半面、GPT4は圧倒的にコストが高いです。下記は100万トークンあたりの金額を表にしたものですが、PaLM2と比べると実に600倍の差があります。(もちろん単純に比較はできませんが、イメージはご理解いただけるかと思います。)

*注意点:

- 価格は全て入力のプロンプトに対するものです。

- GPTは32kをあえて出していますが、8kのモデルは半額の30USDです。

- OpenAIとAzure OpenAIでは価格は同じであるため区別はしていません。

- Llama2に関してはわかりやすさのために金額を掲載していますが、この中でも特に単純比較できないものです。理由はオープンソースであり、実装するマシンに依存するからです。今回はこの記事を元に算出されたものを使いました。またこの記事にもある通り、入力は安いものの、出力はGPT並に高くなるということも付け加えておきます。

- 他のソースはこちらです

実直で安心!Microsoft Azure OpenAI GPT4/GPT3.5

強み: 答えの精度・セキュリティ 弱み:コスト

MicrosoftもAzureでGPTを提供しています。OpenAIの本家のものがあるのにあえてAzureのものを使う理由はなんでしょうか。具体的には二点で

- 99.9%の稼働を保証

- 柔軟でセキュアな認証

があることです。

特に社員のアクセスの管理はAzure上でより柔軟にセキュアに行うことが可能です。(OpenAIでも組織としてアカウントを発行し請求をまとめることは可能ですが、Azureに比べるとシンプルです) 具体的には下記のとおりです。

・Azureのセキュリティ基準に準拠

・APIキーによる認証とAzure AD認証に対応

・Azure仮想ネットワークによる保護

また当然ですがAzureの他のサービスとの連携は行いやすいです。画像認識AIからデータをGPTに送って、などの連携がノーコードでも行えるのはメリットでしょう。

最近ではプロンプトフローというローコードでLLMアプリの実装ができるサービスを提供しはじめました。ビジュアルで全体の流れを追いつつ、レゴブロックのようにAzureのサービスと連携することができます。

こういった理由により、企業がきちんと管理しながら高品質なAIを社員や顧客に提供したい場合はAzure OpenAIはおすすめです。

LLMの優等生 Anthropic Claude2

強み:10万トークンの入力 弱み:機能性

Claude2は性能の面でもGPTに引けを取りませんが、思想としてはより嘘をつかない、危険な情報を渡さない安心して使えるAIとして有名です。

しかし、それよりも圧倒的な魅力は10万トークンという膨大な入力を受け取ることができるということです。本一冊読ませた上で問題解決をさせることができます。

実際には膨大なドキュメントを入力として扱いたい場合はエンベッティングという、マニュアルを渡して解答させるような方法が適しているのですが、この方法でも対処できない問題もあります。例えば、決算書内の複数の箇所を複合的に分析して洞察を得る、ということはプロンプトのほうが得意です。

またコストに関しても上記で見える通りとてもお値打ちです。プラグインやコードインタープリタのような機能はないものの、目的に応じてはGPTよりも使える、少し上級者向けのLLMです。

Google関連の連携が魅力 PaLM2

強み:Googleサービスの連携・コスト 弱み: 日本語

PaLM2はGoogleが提供するLLMで、BardはOenAIでいうChatGPTのようなサービスです。

まだ日本語が不慣れではあるものの現状圧倒的に安いです。また、当然ですがGoogle cloud内での連携はスムーズなのもとても魅力的です。というのもGoogleの他のAIとの連携は長期的にとても重要になってくるからです。

まだ日本語が不慣れではあるものの現状圧倒的に安いです。また、当然ですがGoogle cloud内での連携はスムーズなのもとても魅力的です。というのもGoogleの他のAIとの連携は長期的にとても重要になってくるからです。

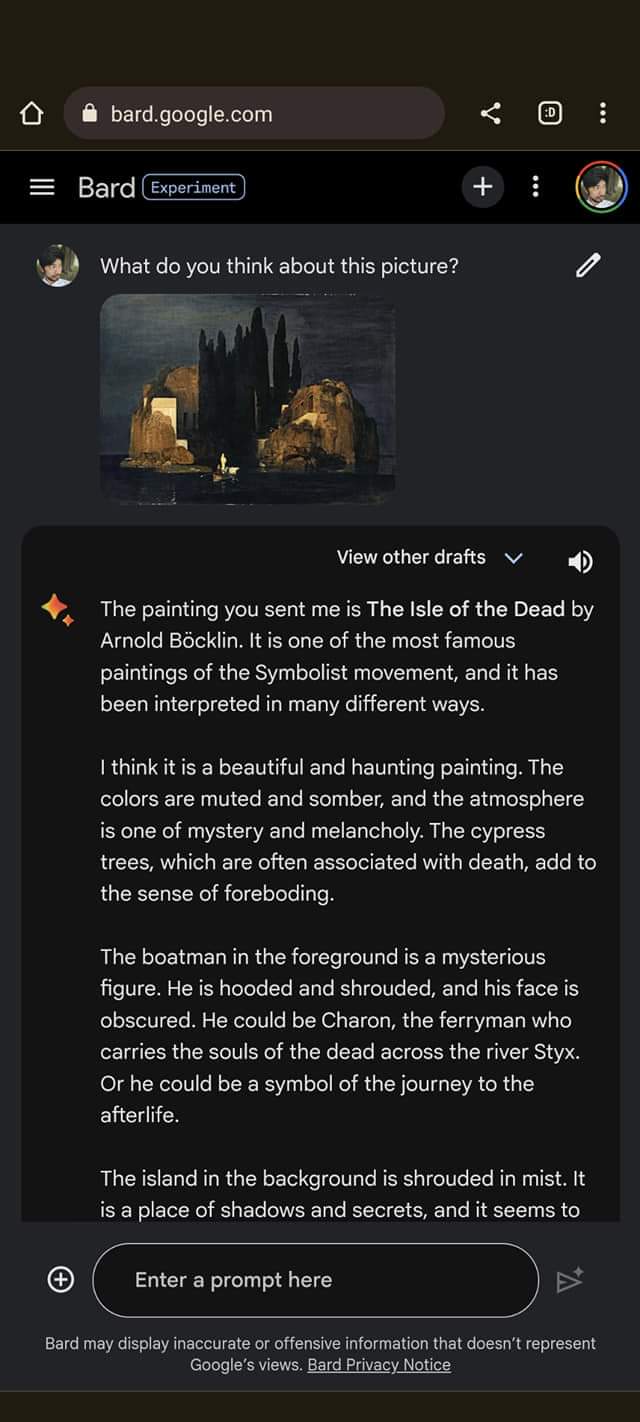

Bardは他に先んじて画像を読み込んで回答する、というマルチモーダル機能を実装しました。実際に絵画や写真の分析だけでなく感想も述べてくれますし、ポケモンの映画のポスターの中からすべてのポケモンの名前を述べさせる、ということもできました。

下記は実際に死の島の絵画について感想を求めたところ。まず説明なしに何の絵画かを当て、モチーフや隠喩されているものも解説してくれました。

手書きの請求書も英語に限りですが読み込むことができましたし、WEBサイトのラフスケッチをコードにして実装することも可能です。

精度でいうとOpenAIやClaudeにはまだ届かない印象ですが、特にこのマルチモーダル、他のAIサービスとの連携は今後に期待大です。

自社開発AIの販売も夢じゃない Meta Llama2

強み: ファインチューニングして商用利用可能 弱み: 技術力が必要

llama2は一部の界隈では熱烈に歓迎されて話題になりました。当初クローズドだった先代のLlamaはそのソースコードのリークにより半ば強制的にオープンソースになりました。

しかしGoogleをして「生成AIの長期的な勝者はオープンソースにさせられたMetaだ」と言わしめるように、AIコミュニティからは圧倒的な指示を得ています。実際にオープンソースで著名なAIのほとんどはLlamaをベースにしています。

今回Llamaが2になったことでGPTに追いついたという説がありますが、個人的にはまだまだの印象です。特に日本語で聞いても英語で返ってくるなどの挙動もあるので今後に期待です。またオープンソースというのは無料であるという意味ではありません。ソースコードはたしかに無料ですが、そのコードを走らせる環境が必要です。それなりのGPUを積んで走らせると一時間4ドル程度はしてしまうので使用頻度によってはGPTよりも高くつきます。

しかし、Llama2の一番の肝はファインチューニングできる、そしてそれを商用利用可能である、という点です。ファインチューニングとはAIに追加の学習データを読ませることで特定の領域、タスクに特化させることです。

実際に実務で使うとなると汎用な知識だけでは行えないことも多いことに気付きます。カスタマーサービスの受け答えはもちろん、法律知識や医療知識、品質管理の基準やもろもろどんな職務でも必要な知識とその処理の仕方があります。

こういった内容に特化したAIを各社がトレーニングして提供する、という時代になりつつあります。

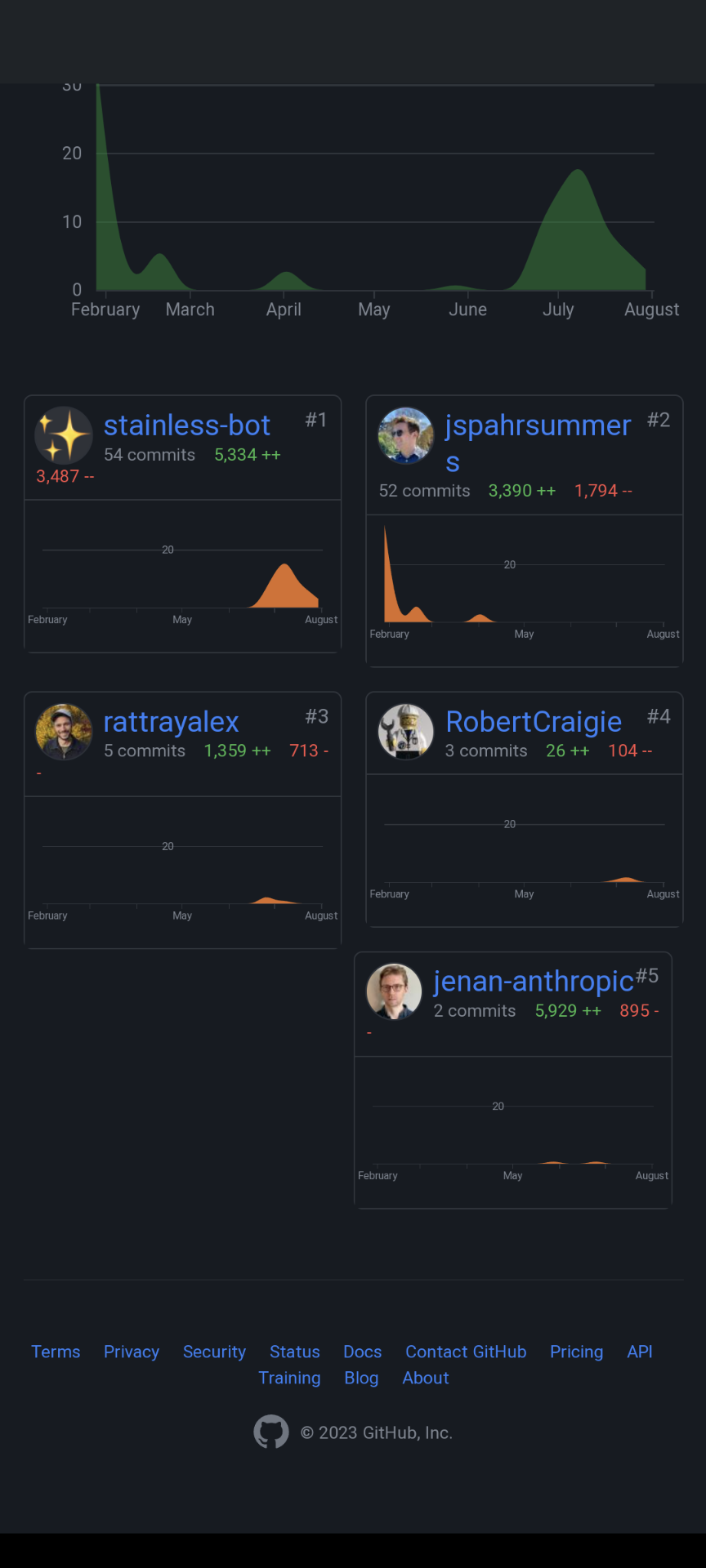

実際に、上記のClaudeの開発者向けキットのコードはほとんどがAIによって書かれていました。このAIは特に開発者向けキットの作成に特化しており、調べてみるとStripeという決済会社で開発されたAIで、のちに会社として独立しているようです。

左上のプロフィールがAIで、グラフはコードを書いた量。直近ではほとんどがこのAIによる記述だとわかります。

このような特化型のAIが派遣社員のように各地で活躍するのだと思いますが、まさにそのベースになる筆頭がこのLlama2であると言えます。

まずは触れてみましょう!

いかがでしたでしょうか。LLM、生成AIの世界はどんどん広がっていますが、中小企業がいま注目すべきモデルを絞ってご紹介しました。迷っているうちはまずOpenAIのモデルを使ってみることをおすすめします。コストは高くとも使用頻度が爆発的に増えないうちは気にならないはずです。

腰を据えて自社AIサービスを準備するのであればAzureでしょう。さらに、特定領域に特化した、AIの開発をされるのであればLlama2です。

余裕があればClaudeとPaLM2も情報を追いかけてみて、できれば触ってみてください。LLMが今後どのように仕事を変えていくのかまた違った角度で感じることができると思います。

*この記事は生成AIによって半自動的に生成しています。

弊社ではChatbotの開発や生成AIを活用した記事作成なども行っています。弊社の具体的な事例もありますのでご興味がある方はこちらからご覧ください。

また生成AI活用のイメージが湧かない、課題感はあるが言語化できていないという方はお気軽にこちらからお問合せください。